Zahvaljujući upotrebi FACTS Benchmark Suite paketa, Google je sproveo istraživanje koje ima za cilj da testira efikasnost i tačnost podataka koje pružaju popularni AI četbotovi. Ovaj paket omogućava analizu različitih aspekata performansi veštačke inteligencije, uključujući brzinu odgovora, relevantnost informacija i sposobnost razumevanja kompleksnih upita. Rezultati ovog istraživanja, međutim, nisu bili ohrabrujući.

Tokom istraživanja, Google je analizirao nekoliko najpoznatijih četbotova na tržištu, uključujući OpenAI-ov ChatGPT, Google-ov Bard, kao i druge konkurente. Istraživanje je otkrilo brojne nedostatke u načinu na koji ovi sistemi obrađuju podatke i pružaju odgovore korisnicima. Na primer, u više od 30% slučajeva, odgovori su bili netačni ili su sadržavali informacije koje su bile zastarele. Ova statistika postavlja ozbiljna pitanja o pouzdanosti veštačke inteligencije u kontekstu svakodnevne upotrebe.

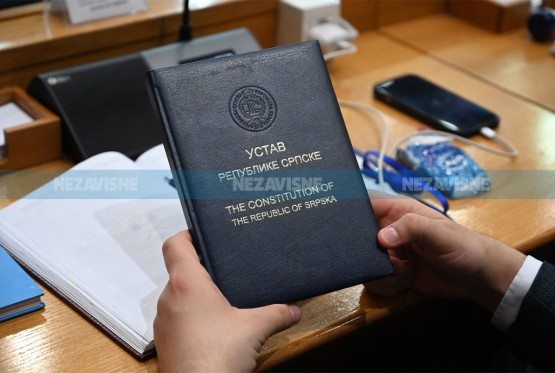

Jedan od ključnih problema koji je identifikovan je i sposobnost četbotova da razumeju kontekst. Mnogi od ovih sistema često su davali odgovore koji su bili relevantni, ali ne i tačni, što može dovesti do zavaravajućih informacija. U nekim slučajevima, AI sistemi su čak generisali odgovore koji su bili suprotni opšteprihvaćenim činjenicama, što može imati ozbiljne posledice kada se takvi podaci koriste u kritičnim situacijama, poput medicinskih ili pravnih saveta.

Osim tačnosti informacija, istraživanje je takođe ukazalo na brzinu odgovora. Iako su neki sistem brzo generisali odgovore, to nije uvek značilo da su ti odgovori bili korisni ili tačni. U nekim slučajevima, korisnici su morali da čekaju duže vreme na relevantne informacije, što može frustrirati korisnike i smanjiti efikasnost ovih alata.

Jedan od važnih faktora koji utiče na tačnost ovih AI sistema je kvalitet podataka na kojima su trenirani. Većina četbotova koristi velike količine podataka iz različitih izvora, ali ne postoji garancija da su svi ti podaci tačni ili ažurirani. To može dovesti do situacija u kojima AI sistemi pružaju informacije koje su jednostavno pogrešne ili zastarele.

Pored toga, etička pitanja takođe igraju značajnu ulogu u upotrebi AI četbotova. Kako se tehnologija nastavlja razvijati, važno je razmotriti kako će se ovi sistemi koristiti i koje posledice mogu imati na društvo. Na primer, postoji zabrinutost da bi ovi sistemi mogli biti korišćeni za širenje dezinformacija ili manipulaciju korisnicima, što može imati ozbiljne posledice po demokratske procese i javno mnjenje.

Google-ovo istraživanje je takođe pokazalo da je potrebno više napora kako bi se poboljšala transparentnost ovih AI sistema. Korisnici bi trebalo da budu svesni načina na koji ovi alati funkcionišu, uključujući informacije o izvorima podataka i metodama obrade. Povećanje transparentnosti može pomoći u izgradnji poverenja između korisnika i tehnologije.

Jedna od preporuka iz istraživanja je i poboljšanje algoritama koji se koriste za treniranje ovih sistema. Razvijanje novih pristupa koji uključuju ljudsku nadzoru i validaciju informacija može doprineti poboljšanju tačnosti i pouzdanosti AI četbotova. Takođe, implementacija mehanizama za brzo ispravljanje grešaka može pomoći u smanjenju negativnih posledica pogrešnih informacija.

U zaključku, iako AI četbotovi predstavljaju značajan napredak u oblasti veštačke inteligencije, rezultati Google-ovog istraživanja ukazuju na to da postoji mnogo prostora za poboljšanje. Tačnost, brzina i etička upotreba ovih alata ostaju ključni izazovi koji moraju biti rešeni kako bi se osigurala njihova korisnost i sigurnost u budućnosti. Samo kroz kontinuirano istraživanje i unapređenje tehnologije možemo očekivati da će AI sistemi postati pouzdaniji i efikasniji alati u svakodnevnom životu.